In der digitalen Welt von heute ist Raten keine Option mehr. Wer seine Conversion-Rate steigern, die Absprungrate senken und den Umsatz maximieren will, kommt an einem Thema nicht vorbei: dem A/B-Split-Testing. Doch was oberflächlich simpel klingt – "wir zeigen Version A und Version B" – entpuppt sich bei näherem Hinsehen als eine hochkomplexe Disziplin aus Psychologie, Statistik und technischem Know-how.

1. Was ist A/B-Testing einfach erklärt?

Stellen wir uns vor, du betreibst einen Stand auf einem Wochenmarkt. Du bist unsicher, ob ein rotes Preisschild oder ein blaues Preisschild mehr Kunden anlockt. Also machst du Folgendes: In der ersten Stunde nutzt du das rote Schild, in der zweiten Stunde das blaue. Am Ende des Tages zählst du die Verkäufe.

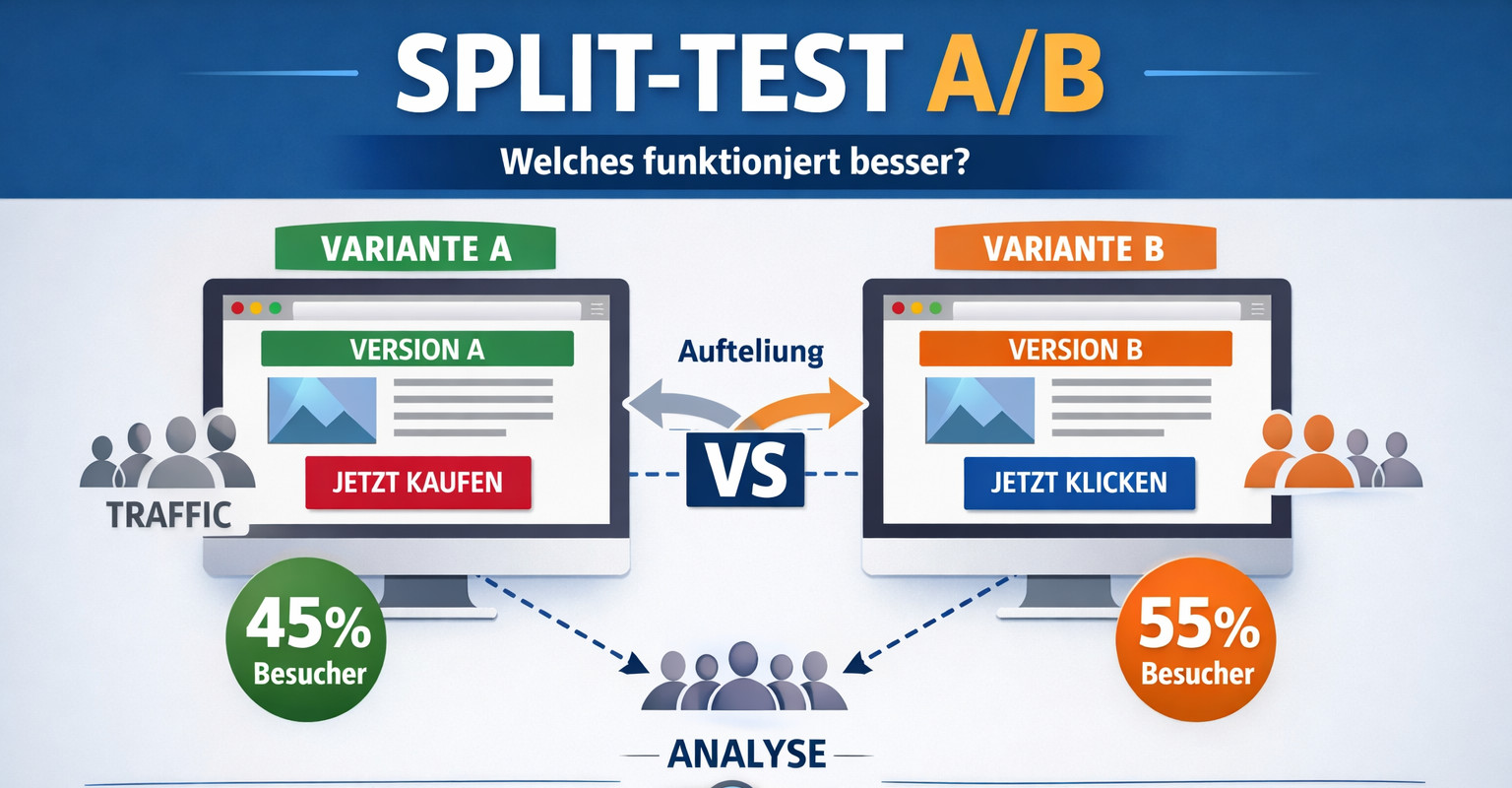

Das ist im Kern ein A/B-Test (auch Split-Test genannt). Im digitalen Marketing passiert dies jedoch gleichzeitig und automatisiert.

Die Definition

Ein A/B-Test ist eine Methode, bei der zwei Versionen einer Webseite, einer E-Mail oder eines Werbemittels direkt miteinander verglichen werden.

- Version A (Control): Das aktuelle Design/Layout.

- Version B (Variation): Eine modifizierte Version mit einer gezielten Änderung (z. B. eine andere Button-Farbe).

Den Nutzern wird per Zufallsprinzip entweder Version A oder Version B ausgespielt. Durch das Tracking der Nutzerinteraktionen lässt sich statistisch belegen, welche Version das definierte Ziel (z. B. einen Kauf oder eine Anmeldung) besser erreicht.

2. Split-Test A/B: Wie funktioniert das technisch?

Technisch gesehen gibt es drei Hauptarten, wie ein Split-Test implementiert werden kann:

- Client-Side Testing: Hierbei wird ein JavaScript-Snippet in den Header der Webseite eingebunden. Wenn ein Nutzer die Seite lädt, verändert das Skript das Layout im Browser des Nutzers (z.B. ändert es die H1-Überschrift). Vorteil: Schnell einzurichten. Nachteil: Kann zu einem "Flackern" der Seite führen.

- Server-Side Testing: Die Entscheidung, welche Version ausgespielt wird, trifft der Server, bevor die Seite an den Browser gesendet wird. Vorteil: Höhere Performance und Sicherheit, ideal für komplexe Änderungen.

-

Split URL Testing (Redirect Test): Hierbei werden zwei völlig unterschiedliche URLs (z. B.

seite.de/variante-aundseite.de/variante-b) verglichen. Der Test-Server leitet 50 % des Traffics direkt um.

Der Prozess in 5 Schritten:

- Datenanalyse: Wo verlassen Nutzer die Seite? (Heatmap-Analyse nutzen).

- Hypothesenbildung: "Wenn ich den Button von Blau auf Grün ändere, werden mehr Leute klicken, weil Grün mehr Aufmerksamkeit erregt."

- Variante erstellen: Die Änderung im Test-Tool umsetzen.

- Testlauf: Den Test für einen statistisch relevanten Zeitraum laufen lassen.

- Auswertung: Analyse der Gewinner-Variante und Implementierung.

3. A/B-Tests für Anfänger: Worauf man unbedingt achten muss

Viele Anfänger begehen den Fehler, "einfach mal loszutesten". Das führt oft zu irreführenden Ergebnissen. Hier sind die kritischen Erfolgsfaktoren:

A. Statistische Signifikanz

Du kannst einen Test nicht nach 10 Besuchern stoppen, nur weil Version B gerade vorne liegt. Du benötigst eine ausreichend große Stichprobe, um sicherzustellen, dass das Ergebnis kein Zufall ist. Die meisten Tools zeigen einen p-Wert oder eine Signifikanz (meist 95 % oder höher) an.

B. Nur eine Variable gleichzeitig testen

Wenn du in Version B die Überschrift, das Bild UND die Button-Farbe änderst, weißt du am Ende nicht, welche Änderung für den Erfolg verantwortlich war. Für multiple Änderungen benötigt man multivariate Tests (MVT), die jedoch deutlich mehr Traffic erfordern.

C. Testdauer

Ein Test sollte mindestens einen vollen Geschäftszyklus (meist 7 Tage, idealerweise 14-21 Tage) laufen, um Wochentagseffekte (Wochenende vs. Werktage) auszugleichen.

D. Externe Faktoren

Achte auf Saisonalität (Black Friday), Werbekampagnen oder technische Störungen während des Testzeitraums, da diese die Daten verzerren können.

4. Beste Plattformen für A/B-Split-Tests (Fokus: Deutschland & E-Commerce)

Die Wahl des richtigen Tools hängt von deinem Budget, deinem Traffic und deinen Datenschutzanforderungen (DSGVO!) ab.

| Tool | Fokus | Besonderheit | Preisniveau |

| VWO (Visual Website Optimizer) | All-in-One | Sehr benutzerfreundlich, inklusive Heatmaps. | Mittel - Hoch |

| AB Tasty | Enterprise / E-Commerce | Stark in der Personalisierung und ROI-Tracking. | Hoch |

| Convert.com | Datenschutz-Fokus | Hervorragender Support, sehr DSGVO-konform. | Mittel |

| Kameleoon | KI-gestützt | Starke Server-Side-Testing Optionen. | Hoch |

| Matomo | Open Source | Die Google Analytics Alternative für volle Datenkontrolle. | Günstig (Self-hosted) |

Warum der Fokus auf Deutschland wichtig ist:

In Deutschland ist die DSGVO (Datenschutz-Grundverordnung) das Maß aller Dinge. Tools wie VWO oder AB Tasty bieten spezielle Server-Standorte in der EU und Funktionen zur Anonymisierung von IP-Adressen an. Wer auf Nummer sicher gehen will, nutzt Tools, die kein Drittanbieter-Cookie benötigen oder hostet Lösungen wie Matomo selbst.

5. Vergleich von A/B-Test-Software für kleine Unternehmen

Kleine Unternehmen haben oft nicht das Budget für 1.000 €/Monat teure Enterprise-Lösungen. Hier sind die besten Optionen:

- Google Analytics 4 (GA4) + GTM: Seit dem Ende von Google Optimize gibt es kein direktes kostenloses Tool von Google mehr. Man kann jedoch via Google Tag Manager einfache Split-URL-Tests bauen und in GA4 auswerten. (Erfordert technisches Wissen).

- Nelio AB Testing (für WordPress): Ein Plugin, das direkt im Dashboard arbeitet. Ideal für kleine Blogs oder lokale Dienstleister.

- Unbounce: Wenn du primär Landingpages baust, ist das A/B-Testing hier direkt integriert.

6. Kostenlose Tools für einfache Split-Tests

Gibt es "echtes" A/B-Testing zum Nulltarif? Ja, aber mit Abstrichen beim Komfort:

- Matomo (On-Premise): Das A/B-Testing-Plugin für Matomo ist zwar kostenpflichtig, aber die Basis-Plattform ist gratis.

- Mousestats: Bietet in der Basis-Version oft begrenzte Test-Möglichkeiten.

- Eigene Skripte: Ein erfahrener Entwickler kann mit wenigen Zeilen JavaScript und einer Anbindung an die Datenbank einen rudimentären Split-Test bauen.

7. A/B-Testing-Software mit Heatmap-Integration: Warum das ein Gamechanger ist

Ein reiner A/B-Test sagt dir was passiert ist (z. B. Version B hat 5 % mehr Klicks). Er sagt dir aber nicht warum.

Hier kommen Tools mit integrierten Heatmaps und Session Recordings (wie VWO oder Hotjar) ins Spiel.

- Heatmap: Zeigt visuell, wo Nutzer klicken und wie weit sie scrollen.

- Session Recording: Du siehst ein Video vom Nutzerbesuch.

Beispiel: Du siehst im A/B-Test, dass eine neue Landingpage schlecht performt. Die Heatmap zeigt dir dann, dass die Nutzer den "Kaufen"-Button auf Mobilgeräten gar nicht sehen, weil er "below the fold" gerutscht ist. Ohne Heatmap hättest du die Hypothese vielleicht fälschlicherweise verworfen.

8. Wie richte ich einen A/B-Test für eine Landingpage ein? (Schritt-für-Schritt)

Landingpages sind die prädestiniertesten Ziele für Split-Tests. So gehst du vor:

Schritt 1: Ziel definieren

Was ist der "North Star"? Newsletter-Anmeldung, Produktkauf oder Klick auf einen Affiliate-Link? Setze dieses Ziel als "Conversion" im Tool fest.

Schritt 2: Die Hypothese

Wähle ein Element aus:

- Headline: "Sichere dir 20% Rabatt" vs. "Werde Teil unserer Community".

- Hero-Image: Produktfoto vs. Foto eines glücklichen Kunden.

- Formular: 5 Felder vs. 3 Felder.

Schritt 3: Das Setup im Editor

Nutze den Visual Editor deines Tools (z.B. VWO), um die Variante B zu erstellen. Ziehe Elemente an neue Positionen oder ändere Texte direkt im Browser.

Schritt 4: Traffic-Split einstellen

Normalerweise 50/50. Bei sehr riskanten Tests kannst du auch erst mit 10 % Traffic für die Variante B starten.

Schritt 5: Integration & Tracking

Stelle sicher, dass das Tool mit deinem Analytics-System (z. B. GA4) kommuniziert, um spätere Segmente (z. B. "Wie haben Besucher aus München im Vergleich zu Berlin reagiert?") zu analysieren.

9. Wie interpretiere ich die Ergebnisse eines A/B-Split-Tests?

Wenn der Test abgeschlossen ist, blickst du auf ein Dashboard. Achte auf diese Kennzahlen:

- Conversion Rate (CR): Der prozentuale Anteil der Besucher, die das Ziel erreicht haben.

- Lift: Die prozentuale Verbesserung von B gegenüber A. ($Lift = \frac{CR_B - CR_A}{CR_A} \times 100$)

- Confidence Level: Liegt es über 95 %? Wenn ja, ist das Ergebnis statistisch belastbar.

- Segments: Hat die Variante B vielleicht nur auf Desktop gewonnen, aber auf Mobile verloren? Solche "Micro-Wins" sind oft die wertvollsten Erkenntnisse.

10. Fallbeispiel: E-Commerce Shop Optimierung

Ein deutscher Online-Shop für Bio-Kaffee testete die Warenkorb-Seite.

- Hypothese: Das Hinzufügen von "Trusted Shops"-Zertifikaten direkt neben dem "Zur Kasse"-Button erhöht das Vertrauen und damit die Conversion.

- Ergebnis: Ein Lift von 12 % bei den abgeschlossenen Käufen bei einer Signifikanz von 98 %.

- Lerneffekt: In Deutschland ist Sicherheit (Social Proof) ein massiver Conversion-Treiber.

Vor- und Nachteile von A/B-Testing

Vorteile:

- Evidenzbasierte Entscheidungen: Kein Rätselraten mehr in Meetings.

- Geringeres Risiko: Neue Layouts werden erst getestet, bevor sie für alle live gehen.

- Stetige Verbesserung: Kleine Gewinne (z.B. je 2 %) summieren sich über ein Jahr zu massiven Umsatzsteigerungen.

Nachteile:

- Zeitaufwand: Gute Tests brauchen Vorbereitung und Zeit für die Ausführung.

- Ressourcen: Man benötigt Traffic. Kleine Webseiten mit weniger als 500 Besuchern im Monat brauchen sehr lange für signifikante Ergebnisse.

- Fokus auf Quantität: Manchmal verliert man die Markenidentität aus den Augen, wenn man nur auf "Klicks" optimiert.

SEO-Metadaten & Checkliste

SEO-Titel (Title Tag)

Split-Test A/B Guide 2026: Tools, Strategien & Profi-Tipps

Meta-Description

Du willst deine Conversions steigern? Lerne alles über A/B-Testing: Von der einfachen Erklärung über die besten Tools bis zur Analyse. Jetzt lesen!

Interne Verlinkungsstrategie

- Verlinke von diesem Beitrag auf: "Conversion Rate Optimization Basics", "Landingpage Design Best Practices".

- Verlinke auf diesen Beitrag von: "E-Commerce Marketing Strategien", "Google Analytics 4 Guide".

Fazit: Warum du heute mit A/B-Testing starten solltest

A/B-Testing ist kein Projekt, sondern ein Mindset. Erfolgreiche Unternehmen wie Amazon oder Netflix führen tausende Tests gleichzeitig durch. In einem Markt, in dem die Klickpreise (CPC) ständig steigen, ist die Optimierung des vorhandenen Traffics durch Split-Tests der effektivste Hebel für profitables Wachstum.

Wichtig für den Start: Fange klein an. Teste eine mutige Änderung (keine Nuancen), um schnell erste Ergebnisse zu sehen.

FAQ: Häufig gestellte Fragen zum A/B-Split-Testing

Um dir den Einstieg und die Optimierung zu erleichtern, haben wir die brennendsten Fragen der Community zusammengefasst und präzise beantwortet.

1. Beeinflussen A/B-Tests mein SEO-Ranking negativ?

Nein, solange du dich an die Best Practices von Google hältst. Google befürwortet A/B-Tests sogar, da sie die Nutzererfahrung verbessern. Wichtig sind drei Punkte:

- Kein Cloaking: Zeige dem Google-Bot nicht systematisch eine andere Version als dem Nutzer.

-

Canonical Tags: Wenn du Split-URL-Tests nutzt, setze einen

rel="canonical"Tag von der Variante auf die Originalseite. - 302 Redirects: Nutze temporäre (302) statt permanenter (301) Weiterleitungen für die Test-Varianten.

2. Wie viel Traffic brauche ich mindestens für einen validen Test?

Es gibt keine fixe Zahl, aber eine Faustregel besagt: Du solltest pro Variante mindestens 100 Conversions (nicht nur Besucher!) erzielen, um statistisches Rauschen auszuschließen. Bei Webseiten mit sehr wenig Traffic (unter 1.000 Besuchern pro Monat) ist A/B-Testing oft nicht effizient. Hier sind qualitative Methoden wie Nutzertests oder Umfragen sinnvoller.

3. Was ist der Unterschied zwischen A/B-Tests und Multivariaten Tests (MVT)?

Während ein A/B-Test zwei Versionen einer Seite vergleicht (z. B. Headline A vs. Headline B), testet ein multivariater Test mehrere Elemente gleichzeitig in allen möglichen Kombinationen (z. B. 3 verschiedene Headlines kombiniert mit 3 verschiedenen Bildern).

- A/B-Test: Braucht weniger Traffic, liefert klare Aussagen über eine Variable.

- MVT: Braucht massiven Traffic, zeigt aber das Zusammenspiel verschiedener Elemente auf einer Seite.

4. Sollte ich lieber die Bayessche oder die Frequentistische Statistik nutzen?

Die meisten modernen Tools wie VWO oder Google Optimize (R.I.P.) nutzen die Bayessche Statistik.

- Bayessch: Liefert eine Wahrscheinlichkeit (z. B. "Variante B ist zu 97 % besser als A"). Dies ist intuitiver für Marketer.

- Frequentistisch: Arbeitet mit dem p-Wert und festen Testlaufzeiten. Es ist mathematisch "strenger", aber im hektischen Marketing-Alltag schwerer zu interpretieren.Für die meisten Unternehmen ist die Bayessche Methode praxisnäher.

5. Kann ich A/B-Tests auch in E-Mails durchführen?

Absolut. Fast alle großen E-Mail-Marketing-Tools (Mailchimp, ActiveCampaign, Klaviyo) haben integrierte A/B-Test-Funktionen. Beliebte Testobjekte sind hier:

- Die Betreffzeile (Öffnungsrate).

- Der Absendername (Vertrauen).

- Der Call-to-Action im Text (Klickrate).

- Der Versandzeitpunkt.

6. Wie gehe ich mit der DSGVO bei A/B-Tests um?

In Deutschland ist dies ein kritischer Punkt. Du solltest:

- Einen Auftragsverarbeitungsvertrag (AVV) mit dem Tool-Anbieter schließen.

- Die IP-Anonymisierung aktivieren.

- Den Test in deiner Datenschutzerklärung aufführen.

- Prüfen, ob das Tool Cookies setzt, die eine Einwilligung im Cookie-Banner erfordern (die meisten Tools tun dies).

7. Was mache ich, wenn ein Test "unentschieden" ausgeht?

Ein sogenannter "Flat Test" ist kein Misserfolg! Er zeigt dir, dass das getestete Element keinen signifikanten Einfluss auf die Entscheidung des Nutzers hat.

Tipp: Werde mutiger. Wenn die Änderung der Button-Farbe nichts bringt, teste ein komplett anderes Wertversprechen (Value Proposition) oder ein völlig neues Seitenlayout.

Checkliste: Dein Weg zum ersten A/B-Test

- [ ] Analytics-Check: Ist mein Tracking (GA4) korrekt eingerichtet?

- [ ] Hypothese: Habe ich eine klare "Wenn-Dann-Weil"-Aussage?

- [ ] Tool-Wahl: Entspricht das Tool meinem Budget und der DSGVO?

- [ ] Variante: Ist die Änderung in Variante B groß genug, um einen Effekt zu erzielen?

- [ ] Laufzeit: Habe ich mindestens 7-14 Tage eingeplant?

- [ ] Dokumentation: Werden die Ergebnisse zentral gespeichert, um "Lern-Verluste" im Team zu vermeiden?